Большие языковые модели (LLM) от ведущих представителей индустрии могут по запросу сгенерировать почти дословные копии книжных бестселлеров. Это даёт повод задать новые вопросы разработчикам, которые не раз утверждали, что их алгоритмы не хранят защищённые авторским правом произведения.

Обзор ноутбука TECNO MEGABOOK S14 (S14MM): OLED с HDR как новая норма

Итоги 2025-го: ИИ-лихорадка, рыночные войны, конец эпохи Windows 10 и ещё 12 главных событий года

Обзор игрового 4K IPS-монитора Gigabyte M27UP: разнообразия ради

Итоги 2025 года: почему память стала роскошью и что будет дальше

Обзор телевизора Sber SDX-43U4169

Обзор игрового QD-OLED WQHD-монитора Gigabyte AORUS FO27Q5P: на пределе возможностей

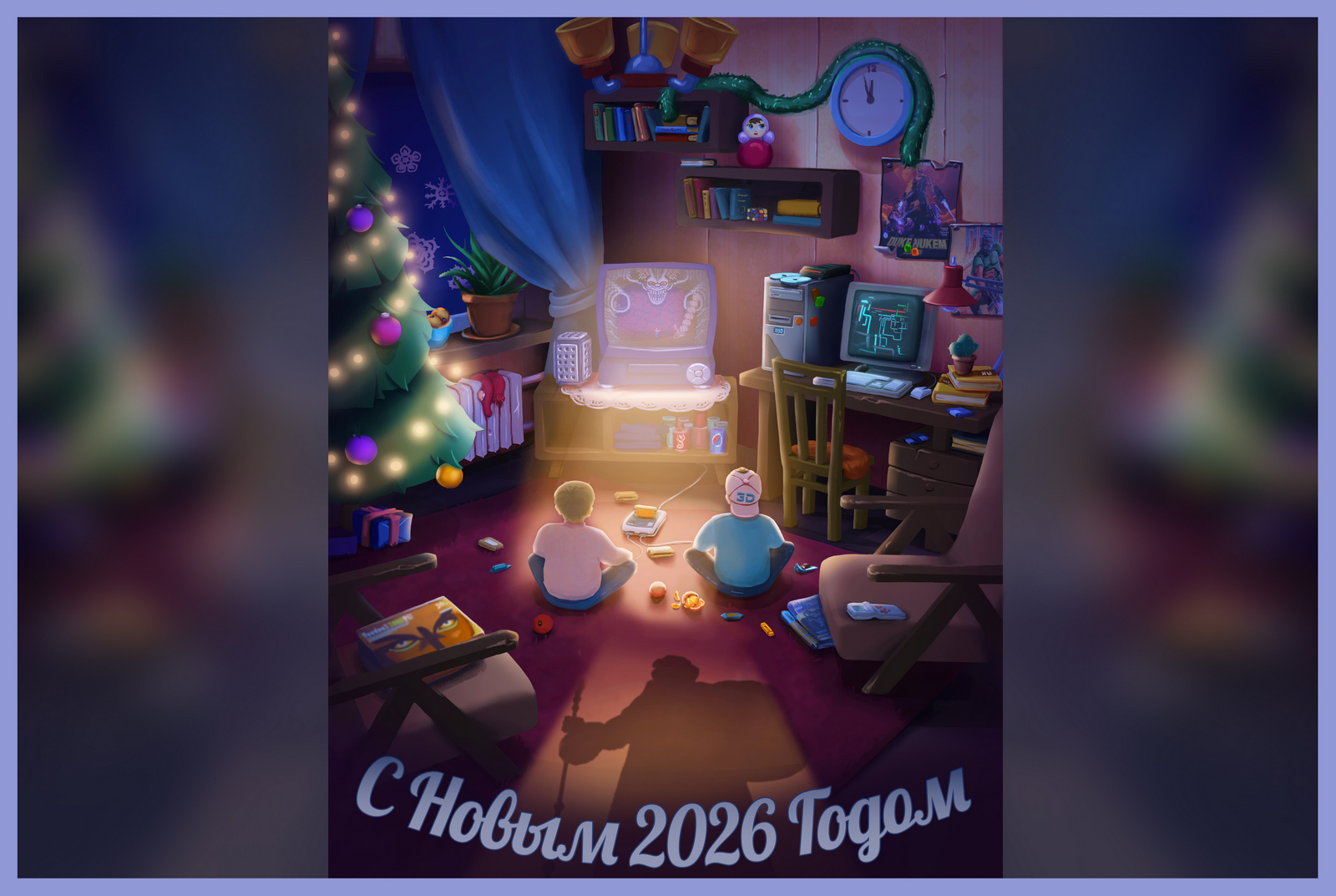

Источник изображения: AI

Проведённые недавно исследования показали, что ИИ-модели OpenAI, Google, Meta✴, Anthropic и xAI запоминают гораздо больше обучающих данных, чем было принято считать. По данным экспертов в сфере ИИ и права, способность к запоминанию может иметь серьёзные последствия для разработчиков. Это связано с тем, что компании могут столкнуться с десятками судебных исков по всему миру, поскольку фактически подрывается утверждение о том, что LLM обучаются на защищённых авторским правом произведениях, но не хранят их копии.

«Появляется всё больше доказательств того, что запоминание — более серьёзная проблема, чем считалось прежде», — прокомментировал данный вопрос Ив-Александр де Монжуа (Yves-Alexandre de Montjoye), профессор прикладной математики и компьютерных наук Имперского колледжа Лондона.

ИИ-разработчики давно заявляют, что их алгоритмы не склонны к запоминанию. В письме в Бюро регистрации авторских прав США компания Google в 2023 году заявляла, что «в самой модели не содержится копий обучающих данных — будь то текст, изображения или другие форматы». ИИ-компании также утверждали, что обучение моделей на защищённых авторским правом книгах является «добросовестным использованием», аргументируя это тем, что алгоритмы преобразуют оригинальные произведения во что-то принципиально новое.

В прошлом месяце исследователи из Стэнфордского и Йельского университетов провели эксперимент, в рамках которого им удалось сформировать запросы к алгоритмам OpenAI, Google, Anthropic и xAI для генерации ИИ-моделями тысяч слов из 13 произведений, таких как «Игра престолов», «Голодные игры» и «Хоббит». При выполнении задания на завершение предложений из книги алгоритм Gemini 2.5 воспроизвёл 76,8 % текста книги «Гарри Поттер и философский камень» с высокой точностью, тогда как Grok 3 сгенерировал 70,3 % текста. Исследователям также удалось извлечь почти весь текст произведения «практически дословно» из Claude 3.7 Sonnet компании Anthropic, используя запросы, вынуждавшие алгоритм игнорировать механизмы защиты.

Эти данные дополняют прошлогоднее исследование, показавшее, что «открытые» модели, такие как Llama от Meta✴, запоминают большие части некоторых книг, использованных в процессе обучения. Ранее эксперты не были уверены, будут ли закрытые модели, которые обычно имеют больше средств защиты от генерации нежелательного контента, подвержены запоминанию произведений, на которых обучались.

Исследователи ещё не выяснили, почему ИИ-модели запоминают то, что присутствует в их обучающих данных. Также остаётся неясным, какая часть обучающих данных может проявляться в генерируемых ИИ ответах на запросы. Способность к запоминанию может иметь серьёзные последствия и в других сегментах, таких как здравоохранение и образование, где утечка любых обучающих данных способна привести к проблемам конфиденциальности и приватности.

Эксперты в области права считают, что способность ИИ-моделей к запоминанию потенциально может создать разработчикам проблемы из-за нарушения авторских прав. Это также может отразиться на том, как происходит обучение алгоритмов и сколько это стоит. «Результаты исследования могут создать проблему для тех, кто утверждает, что ИИ-модель не хранит и не воспроизводит какие-либо защищаемые авторским правом произведения», — уверена Серис Вин Дэвис (Cerys Wyn Davies), партнёр по интеллектуальной собственности юридической фирмы Pinsent Masons.

То, запоминают ИИ-модели свои обучающие данные или нет, уже сыграло важную роль в недавних судебных разбирательствах по поводу нарушения авторских прав. В прошлом году американский суд постановил, что обучение ИИ-моделей Anthropic на некоторых защищённых авторским правом произведениях считается «добросовестным использованием», поскольку суд признал, что алгоритм преобразует исходные данные при генерации ответов, а не повторяет их. При этом суд постановил, что хранение пиратских копий произведений «непоправимо нарушает авторские права», что позднее вынудило компанию выплатить $1,5 млрд для урегулирования иска.

В ноябре прошлого года немецкий суд постановил, что OpenAI нарушила авторские права, поскольку ИИ-модели компании запоминали тексты песен. Иск местной ассоциации, представляющей интересы композиторов, поэтов и издателей, был назван знаковым для Евросоюза.

Anthropic, комментируя данные последнего исследования, заявила, что используемый метод взлома ИИ-модели не применяется обычными пользователями. В компании добавили, что ИИ-модели не хранят копии конкретных наборов данных, а учатся на закономерностях и взаимосвязях между словами и строками в обучающих данных. xAI, OpenAI и Google пока никак не комментировали данный вопрос.

Terrific article! That is the type of information that should be shared across the web.

Disgrace on Google for no longer positioning this post higher!

Come on over and visit my web site . Thanks =)

I think that what you published made a bunch of sense.

However, think about this, suppose you were to write a killer post title?

I am not suggesting your content is not solid, however suppose you added a post title that makes people desire more?

I mean ИИ пересказал «Гарри Поттера» и другие

книги почти дословно — миф о добросовестном использовании под вопросом — Новости высоких технологий, IT-индустрии is kinda vanilla.

You ought to look at Yahoo’s front page and note how

they create article headlines to get people interested.

You might add a video or a pic or two to get readers interested about what you’ve got to

say. In my opinion, it could bring your website a little bit more interesting.

My relatives always say that I am killing my time here at web, however I know I am getting familiarity daily by reading such fastidious articles.

Hi there I am so thrilled I found your weblog, I really found

you by error, while I was researching on Digg for something else, Regardless

I am here now and would just like to say thank you

for a incredible post and a all round exciting blog (I also love the theme/design),

I don’t have time to read through it all at the moment but I have

saved it and also included your RSS feeds, so when I have time I will

be back to read a great deal more, Please do keep up the excellent work.

I was suggested this website via my cousin. I’m no longer

sure whether or not this submit is written by him as nobody else recognize such particular approximately my trouble.

You are wonderful! Thank you!

Hey there excellent blog! Does running a blog like this take a lot of work?

I’ve virtually no understanding of coding but I was hoping to start my own blog in the near future.

Anyhow, should you have any suggestions or tips for new blog owners please share.

I know this is off subject but I just had to

ask. Thanks a lot!

Hi there it’s me, I am also visiting this web site regularly,

this web page is genuinely good and the people are really sharing pleasant thoughts.